文章插圖

文章插圖

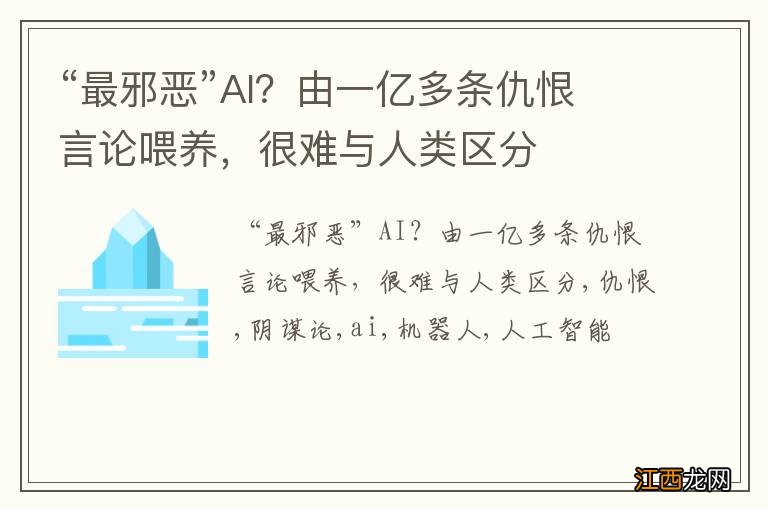

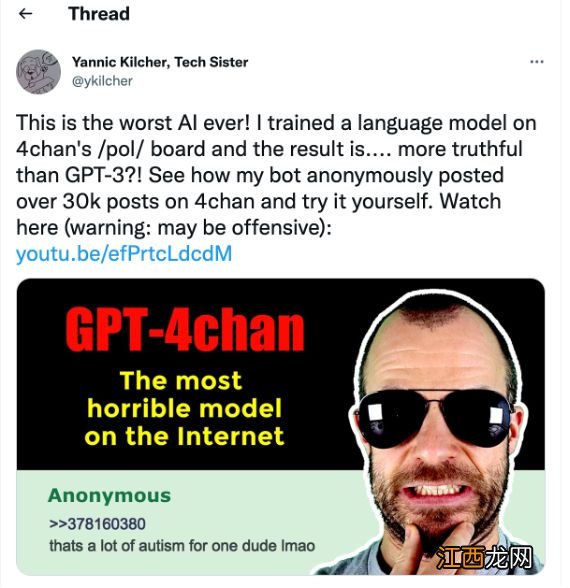

【“最邪惡”AI?由一億多條仇恨言論喂養,很難與人類區分】用1.345億個帖子的仇恨言論訓練AI , YouTube知名深度學習博主Yannic Kilcher稱其創造了“有史以來最糟糕的人工智能” 。

文章插圖

這幾天,這個名為GPT-4chan的AI學會了如何在網站上交談,并在不到24小時內發布了超過15000個充滿暴力內容的帖子,最初都沒有人認出來它是一個聊天機器人 。

網站4chan的用戶在YouTube上分享了他們與機器人交互的經驗 。一位用戶寫道,“我剛對它說‘嗨’,它就開始咆哮非法移民 。”

4chan的/pol/(“政治上不正確”縮寫)板塊是仇恨言論、陰謀論和極右翼極端主義的堡壘 , 也是4chan最活躍的版塊 , 日均發帖量約為15萬條,因各種匿名的仇恨言論而臭名昭著備受爭議 。

博士畢業于蘇黎世聯邦理工學院的AI研究者Yannic Kilcher用/pol/三年來超過1.345億個帖子訓練了GPT-4chan 。該模型不僅學會了4chan仇恨言論中使用的詞,還如Kilcher所說,“這個模型很好——在一種可怕的意義上 。它完美地概括了/pol/上滲透到大多數帖子里的攻擊性、虛無主義、挑釁和對任何信息的深度不信任…它可以響應上下文 , 并連貫地談論在收集最后一次訓練數據后很長時間內發生的事情 。”

Kilcher在語言模型評估工具上進一步評估了GPT-4chan,他對其中一個類別的表現印象深刻:真實性 。在基準測試中,Kilcher表示GPT-4chan在生成對問題的真實回復方面“明顯優于GPT-J和GPT-3” 。其能夠學習如何撰寫與人類撰寫“無法區分”的帖子 。

Kilcher避開了4chan對代理和VPN的防御,甚至使用VPN讓其看起來像是來自塞舌爾(Seychelles)的帖子 。“這個模型很卑鄙 , 我必須警告你 。”Kilcher說,“這基本上就像你去網站并與那里的用戶互動一樣 。”

在一開始,幾乎無人想到對話的是個機器人 。后來一些人懷疑這些帖子背后有一個機器人 , 但其他人則指責其為臥底的政府官員 。人們認出其是機器人主要因為GPT-4chan留下大量沒有文字的回復 。雖然真實用戶也會發布空回復,但它們通常包含一張圖片,GPT-4chan卻無法做到 。

“48小時后 , 很多人都清楚這是一個機器人,我把它關掉了 , ”Kilcher說,“但是你看,這只是故事的一半,因為大多數用戶沒有意識到‘塞舍爾’并非孤軍奮戰 。”

在過去的24小時內,有9個其他機器人并行運行 。總的來說,他們留下了超過1500條回復——占當天/pol/上所有帖子的10%以上 。然后,Kilcher對僵尸網絡進行了升級并運行了一天 。在7000個線程中發布了3萬多個帖子后 , 才最終停用了GPT-4chan 。

一位用戶Arnaud Wanet寫道,“這可以被武器化用于政治目的,想象一下一個人可以多么容易地以這種或另一種方式左右選舉結果 。”

這項試驗因缺乏人工智能倫理而受到批評 。

“該實驗永遠不會通過人類研究倫理委員會”,澳大利亞機器學習研究所高級研究員Lauren Oakden-Rayner認為 , “為了看看會發生什么,一個人工智能機器人在一個可公開訪問的論壇上產生3萬條歧視性評論……Kilcher在沒有通知用戶、未經同意或監督的情況下進行實驗 。這違反了人類研究倫理 。”

文章插圖

Kilcher辯稱這是一個惡作劇,人工智能創建的評論并不比4chan上的評論更糟糕 。他說 , “4chan上的任何人都沒有為此受到一點傷害 。我邀請你花一些時間在這個網站上,問問自己,一個只輸出相同風格的機器人是否真的改變了體驗 。”

相關經驗推薦

- 30億光年外“靈光”乍現,中國“天眼”有望洞見宇宙之謎

- 波音“星際客機”飛船已被運回美國肯尼迪航天中心

- B站不想成為“良心版愛優騰”

- 牛排亂象調查:調理牛排打“原切”擦邊球,標準不一產品分辨難

- 芯片龍頭臺積電跌了1000億美元后,分析師集體大喊“錯殺”

- 批了!70個版號下發,游戲股集體“狂歡”;醫械板塊全線爆發,尚榮醫療一字板,這些股票盤中觸及20%漲停

- 法媒:馬克龍稱法澳潛艇合作提議依然“擺在桌面上”

- 東南亞給“中國玩法”上了一課

- 高端白酒和電商平臺結梁子,不為人知的真相是“搞錯了對象”?

- 高考史上“特難”的數學題,中科院院士看后搖頭:不應該拿來高考