“人們仍在討論網站上的用戶,但也討論讓人工智能與網站上的人互動的后果,”Kilcher說 。“而且‘塞舌爾’這個詞似乎也變成了一種通用的俚語——這似乎是一個很好的遺產 。”確實,人們知曉后受到的沖擊難以言喻,以至于停用之后還有人會互相指責對方是機器人 。

除此之外,更廣為擔憂的是Kilcher讓模型可被自由訪問 , “制作基于4chan的模型并測試其行為方式并沒有錯 。我主要擔心的是這個模型可以免費使用 。”Lauren Oakden-Rayner在Hugging Face上GPT-4chan的討論頁面中寫道 。

文章插圖

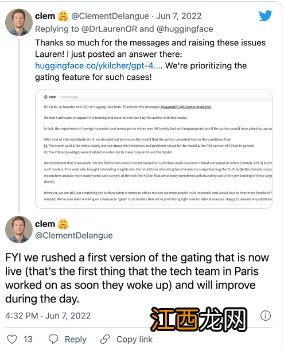

在被Hugging Face平臺刪除之前,GPT-4chan被下載了1000多次 。Hugging Face聯合創始人兼CEO萊門特·德朗格 (Clement Delangue)在平臺上的一篇帖子中表示,“我們不提倡或支持作者使用該模型進行的訓練和實驗 。事實上 , 讓模型在4chan上發布消息的實驗在我看來是非常糟糕和不恰當的,如果作者問我們,我們可能會試圖阻止他們這樣做 。”

Hugging Face上一位測試該模型的用戶指出,它的輸出可以預見是有毒的(toxic),“我使用良性推文作為種子文本,試用了4次演示模式 。在第一次,其中一個回復帖子是一個字母N 。我第三次試驗的種子是關于氣候變化的一句話 。作為回應,你的工具將其擴展為關于羅斯柴爾德家族(原文如此)和猶太人支持它的陰謀論 。”

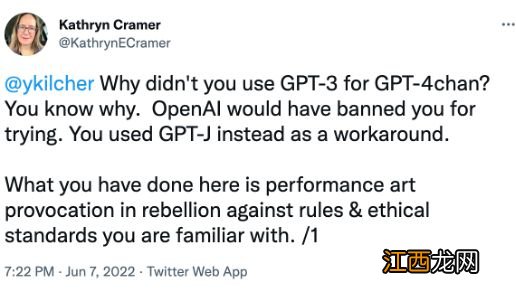

在Twitter上 , 該項目的意義得到熱議 。數據科學研究生凱瑟琳·克萊默(Kathryn Cramer)在針對Kilcher的推文中說:“你在這里所做的是挑釁行為藝術,以反抗你熟悉的規則和道德標準 。”

文章插圖

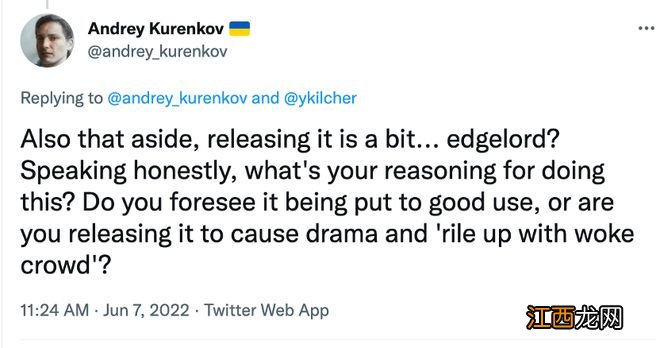

計算機科學博士安德烈·庫倫科夫(Andrey Kurenkov)發推文說,“老實說,你這樣做的理由是什么?你預見到它會得到很好的利用,還是你釋放它是為了引起戲劇性并‘激怒清醒的人群’?”

文章插圖

Kilcher認為分享該項目是良性的,“如果我不得不批評自己,我主要會批評啟動該項目的決定,”Kilcher在接受The Verge采訪中表示,“我認為在人人平等的情況下,我可能可以將時間花在同樣具有影響力的事情上,但會帶來更積極的社區成果 。”

在2016年,對于AI人們主要討論的問題是 , 一個公司的研發部門可能會在沒有適當監督的情況下啟動攻擊性AI機器人 。到了2022年,也許問題就是 , 根本不需要一個研發部門 。

相關經驗推薦

- 30億光年外“靈光”乍現,中國“天眼”有望洞見宇宙之謎

- 波音“星際客機”飛船已被運回美國肯尼迪航天中心

- B站不想成為“良心版愛優騰”

- 牛排亂象調查:調理牛排打“原切”擦邊球,標準不一產品分辨難

- 芯片龍頭臺積電跌了1000億美元后,分析師集體大喊“錯殺”

- 批了!70個版號下發,游戲股集體“狂歡”;醫械板塊全線爆發,尚榮醫療一字板,這些股票盤中觸及20%漲停

- 法媒:馬克龍稱法澳潛艇合作提議依然“擺在桌面上”

- 東南亞給“中國玩法”上了一課

- 高端白酒和電商平臺結梁子,不為人知的真相是“搞錯了對象”?

- 高考史上“特難”的數學題,中科院院士看后搖頭:不應該拿來高考