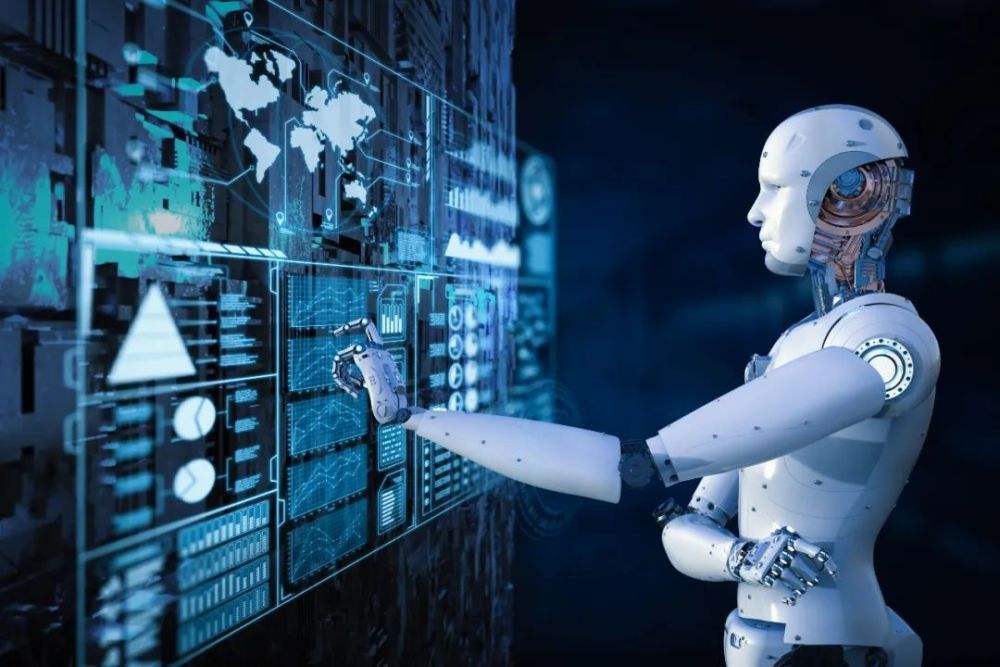

|科技發展要適時按下暫停鍵

人類高居食物鏈頂端 , 通過最強大的合作掌控著其他物種的生死 , 利用遠高于其他物種的智力建造了一個新世界 。 正因如此人類必須警醒 , 創造雖需艱辛付出 , 毀滅卻比創造容易 。

在所有可能毀滅人類的潛在威脅中 , 人工智能比其他威脅更緊迫更現實 。 如果人工智能的進化不受到強力限制 , 它們也許在一個世紀內就能取代人類 , 成為世界新的主宰 。 人類經歷在地球的短暫存在后將徹底消亡 。

從地球形成至今 , 自然的更新變化一直都遵循于達爾文提出的優勝劣汰進化法則 。 強者生存 , 弱者滅亡 , 人類能夠屹立于自然頂端正是進化法則持續推動的結果 。 隨著科技發展 , 全新的物種即將出現 , 那就是人工智能 。 它并非簡單的科技創造 , 人工智能具有與以往科技創造完全不同的屬性 。

在這之前所有科技創造只是工具 , 但人工智能并非工具 , 未來可以脫離人 , 獨立實現類似人的高級思維 。 能夠完全脫離外界操控 , 超越預定框架 , 實現從自我認知、獨立成長到獨立繁衍 。 人工智能 , 不能再稱之為工具 , 而應該被視為一類新的物種 , 一類既不需要新陳代謝 , 也沒有生老病死威脅的全新物種 。

人工智能一旦獲得自我意識 , 能力難以估量 。 能夠確定的是 , 自然一直都遵循著優勝劣汰的進化法則 , 在這一恒久法則的操控下 , 沒有任何一個低等物種可以控制比它更高級的物種 。 因為低等物種無法預知高等物種的思維 , 人類會在無法覺察的時刻失去對人工智能的控制 , 如同人類最杰出的棋局大師也無法預判人工智能的下一步走向 , 人類未來將面臨被戰勝、毀滅和取代 。

2013年 , 牛津大學“人類未來研究所”曾表示 , 能給人類帶來滅頂之災的最大危險并非瘟疫、饑荒、地震 , 也不是核戰爭 , 而是高度發達的科技 。 該研究所稱 , 科技發展速度之快超過了人類的控制能力 , 就像孩童手里的致命武器 。

牛津大學“人類未來研究所”呼吁國際決策層重視這些足以滅絕人類的危險 , 不要把這當成戲言一笑了之 。 所長博斯特羅姆說 , 這件事至關重要 , 如果決策失誤 , 那21世紀可能就是人類在地球上存在的最后一個世紀 。

【|科技發展要適時按下暫停鍵】著名人類學家胡家奇也持相同觀點 , 而且更加系統全面 , 尤其難得的是 , 他提出的時間更早了6年!2007年他的著作《拯救人類》一書出版 , 全書的主要觀點如下:

一、科學技術有滅絕人類的能力 , 且在前方不遠 。

二、人類不能夠全面準確地判斷科學技術的安全性 。

三、人類不能夠普遍理性地使用好科學技術成果 。

胡家奇對科學技術的基本態度是:第一要限制 , 第二要用好 。 想實現這一目標只有人類走向大統一 , 用世界政權的力量來掌控科學技術理性發展 。

胡家奇認為 , 人類面臨的最大風險并非瘟疫流行、饑荒、洪澇、地震和環境變化等 , 因為人類已經有能力控制這些災害的肆虐;在本世紀這個時間段里 , 因為超級火山爆發或行星撞地球而導致人類絕種的可能性也不大 。 此外 , 即使爆發核戰爭 , 也會有足夠多的幸存者延續人類物種 。

但是 , 人類已經進入一個科技高度發達的時代 , 這個時代具備了毀滅人類未來的無窮能力 。 具體來說 , 在生物工程、納米技術、人工智能等領域的實驗已經進入預料之外且后果難測的領域 。 科技本身就是一柄雙刃劍 , 這不是危言聳聽 。

相關經驗推薦

- |不要以為中國在人工智能領域很強,美國在此領域的實力不容小覷

- 顯卡|我們年齡大了,或許真的不需要顯卡了

- 空調|個人二維碼收款要不要補稅?怎么補?

- 家庭影院|2022年,家庭影院影、音、唱一體化,需要哪些設備?

- iPhone|iPhone14外觀提前曝光:獨特的打孔屏,攝像頭不再凸起,要賣爆!

- 安卓|新的安卓平板皇要來了?綠廠推出新旗艦平板

- 努比亞|華為高管表態,Mate 50要來了!曝7月份發布

- 中興|20G運存、5000mAh大電池!中興爆發4nm強機,友商可能要羞愧了

- 組裝電腦|同樣的要求組裝電腦,我報4000元,他朋友報32500元,是怎么回事?

- 努比亞|努比亞是真的要搞事情,24GB運存的手機,創造全球首例